In dieser Podcastfolge gibt es exklusive Einblicke in die Qualitätsüberwachung und Werkstückanalytik mit Edge Computing. Siemens Motion Control liefert IoT-Praxis aus dem Shopfloor, direkt von der Werkzeugmaschine.

Folge 61 auf einen Blick (und Klick):

- [08:40] Herausforderungen, Potenziale und Status quo – So sieht der Use Case in der Praxis aus

- [14:30] Lösungen, Angebote und Services – Ein Blick auf die eingesetzten Technologien

- [31:24] Ergebnisse, Geschäftsmodelle und Best Practices – So wird der Erfolg gemessen

- [34:21] Übertragbarkeit, Skalierung und nächste Schritte – So könnt ihr diesen Use Case nutzen

Zusammenfassung der Podcastfolge

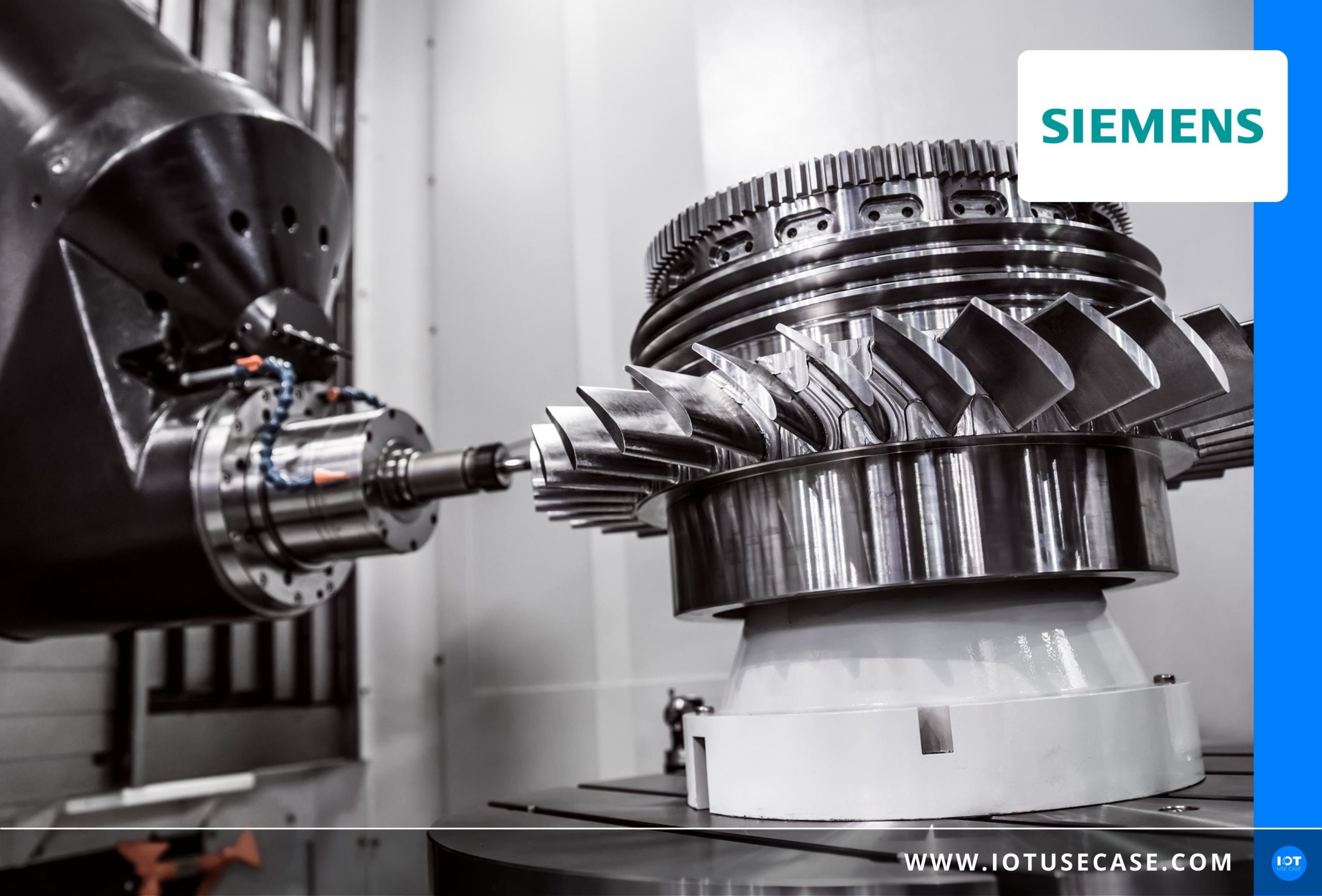

In Folge 61 des IoT Use Case Podcast geht es um die Digitalisierung der spanenden Bearbeitung metallischer Werkstücke mit CNC-gesteuerten Werkzeugmaschinen. Zwei Praxisbeispiele werden in dieser Folge besprochen: ein Use Case aus dem Monitoring der Einzelteilfertigung und einer aus der Serienteilfertigung.

Das Anwendungsbeispiel aus der Serienfertigung kommt aus dem Automobilbereich. Es wird aufgezeigt, wie Prozesse überwacht werden und das Qualitätsmanagement mit IIoT in der siemenseigenen Motorenfabrik in Bad Neustadt optimiert wird. Wurden die Bauteile richtig in die Spannvorrichtung eingelegt? Stimmt die Qualität des Zahnrades? Passt der Drehmoment der Werkzeugspindel oder kommt es zu Anomalien? – alles Prozesse, die lückenlos abgebildet werden können. Der zweite Use Case kommt aus der Einzelteilfertigung aus dem Aerospace. Hier geht es um die Titanzerspanung von Flugzeug-Landebeinen. Dieser aufwendige Fräsprozess wird komplett digital abgebildet, um Fehler im Teileprogramm und Abweichungen von der Soll-Geometrie zu erkennen und diese zu vermeiden, bevor es zu kostspieligen Iterationsschleifen kommt. Die Abbildung des riesigen Bauteils in der virtuellen Welt hilft bei der Suche (nach Ursachen) von Qualitätsmängeln und reduziert immense Kosten.

Dreh- und Angelpunkt der Lösung ist das sogenannte Industrial Edge for Machine Tools – ein IPC, der direkt im Schaltschrank der Maschine hängt und die Daten vorverarbeitet. Er ermöglicht einen hochfrequenten Datenzugriff und Analysen zur Optimierung der Werkstückqualität und Produktivität. Alte Maschinen können beispielsweise mit Konnektivität nachgerüstet werden, indem das Tool als eine Art Konverter auftritt, und alte Schnittstellen in neue, wie OPC UA, verwandelt.

Madeleine Mickeleits Gäste in dieser Folge:

- Oliver Eckstein (Product Manager Industry Software for Machine Tool Digitalization, Siemens)

- Bjoern Rosenbaum (Produktmanager Industry Software, Siemens)

Podcast Interview

Ein herzliches Hallo an Oli und Bjoern. Schön, dass ihr mit dabei seid. Freut mich sehr.

Oli

Hi Madeleine, vielen Dank, dass wir hier sein dürfen.

Bjoern

Ja, hi, hallo auch von meiner Seite.

Ihr beide seid bereits viele Jahre bei Siemens im Kontext der CNC-gesteuerten Werkzeugmaschinen unterwegs – Digitalisierung an der Werkzeugmaschine sozusagen. Heute soll es uns um das sogenannte Industrial Edge for Machine Tools gehen. Euer Job dreht sich hier einerseits um die Mechanik an der Werkzeugmaschine, aber auch um den IT- und App-Bereich drumherum. Im Endeffekt geht es hier um die ganzen Schnittstellen und die sichere und lückenlose Datengewinnung. Oli, du bist hier unser Applikationssprechpartner, und Bjoern, du bist rund um die Plattform und das Ökosystem sozusagen zuständig. So kann man das verstehen, oder?

Bjoern

Genau, das ist genau richtig.

Sehr schön. Ich meine, der ein oder andere kennt wahrscheinlich CNC-Fräsmaschinen. Aber trotzdem, um das ganze Thema mal so ein bisschen einzuordnen: Wo kommen denn eure CNC-Maschinen heute zum Einsatz? Also wo stehen die? Mal so einfach vielleicht ein Beispiel genannt, aus der Praxis – Bjoern, kannst du uns da mal abholen, wo stehen die Maschinen und was machst du da?

Bjoern

Ja, grundsätzlich findest du Werkzeugmaschinen in den Branchen Automobil und Aerospace. Die stehen da praktisch in den Hallen, wo auch immer wir es mit spanender Bearbeitung von metallischen Werkstücken zu tun haben. Also klassische Stahl und Alu, im Automobilbereich, Motorblockfertigung. Auch die rotatorischen Systeme, der ganze Antriebsstrang, die Achsen und die Lager. Im Aerospace sind wir dann auch viel bei Triebwerksfertigung, also die Werkzeugmaschinen vor allen Dingen. Unterschiedlichste Materialien und High-end-Technologie.

Jetzt spreche ich im Podcast, wie immer, über konkrete Use Cases aus der Praxis. Anhand dessen man mal wirklich konkret versteht, was sind jetzt neue Technologien? Und was zum Beispiel auch eure Industrial Edge for machine tools mitbringt. Welche Use Cases habt ihr denn für uns mitgebracht, um mal so ein bisschen zu diskutieren, wie das im Detail funktioniert? Oli, vielleicht hast du einen Use Case aus deinem Bereich, den du uns hier mal vorstellen kannst.

Oli

Ja, genau. Wir sehen einen Use Case ganz klar in der Serienfertigung. Jetzt mal wirklich im Allgemeinen. Muss jetzt gar nicht um einen ganz konkreten Prozess gehen. Das Qualitätsmanagement ist da immer so einer, ich nenne es immer, Unschärferelation ausgeliefert. Einerseits könnte man jetzt jedes Bauteil, was man produziert in der Serienfertigung, überprüfen. Dann habe ich zwar eine lückenlose Überwachung, aber dadurch wird mein Prozess sehr teuer und sehr langsam. Wenn ich sage, okay, ich reduziere das jetzt und mache nur noch Stichproben, vielleicht nur noch jedes hundertste Bauteil – dann ist vielleicht mein Prozess günstiger, ja. Aber ich habe dann halt nicht mehr so einen guten Überblick über die Qualitätssituation. Genau das Monitoring eines solchen Serienprozesses, das ist ein so ein Use Case, den wir hier genauer betrachten können.

Spannend. Habt ihr da noch einen zweiten Use Case, Bjoern, vielleicht mal in deine Richtung geschaut?

Bjoern

Ja, ich hätte da jetzt auch noch einen dazugepackt. Nämlich, nicht nur die Serienfertigung interessiert uns, sondern es gibt ja auch noch die Einzelteilfertigung. Oder nennen wir es mal kleine Losgrößen. Wo es einfach nur um ein paar wenige Bauteile geht, die vielleicht aber unter Umständen groß und teuer sind. Dann brauche ich Spezialwerkzeuge unter Umständen dafür. So was kann relativ schnell sehr kostenintensiv werden. Wenn ich da ein Auftragsfertiger bin und muss relativ schnell liefern, dann wäre es auch sehr gut, wenn man diesen Run-in-Prozess, also diesen Versuch in der Simulation einigermaßen gut vorbereiten und absichern kann, bevor ich dann unnötig viele Bauteile oder Fräsversuche – die ja auch kosten- und zeitintensiv sind – benötige, um am Ende ein gutes Bauteil zu erhalten. Und darum geht es ja letzten Endes. Möglichst ein qualitativ hochwertiges Bauteil abzuliefern.

Genau. Bevor ich jetzt noch mal tiefer in die Use Cases einsteige, vielleicht noch mal ganz kurz zur Verortung. Oli, jetzt hattest du gerade schon gesagt, es geht ja auch darum, Optimierungspotenziale, das Potenzial aus den Daten zu nutzen. Was ist denn hier eure Vision im Bereich Digitalisierung? Wovon träumen eure Kunden? Wovon träumt ihr? Wo geht ihr mit dem Thema hin? So als ganzheitliche Vision.

Oli

Ja, wirklich so ganz, ganz plakativ gesagt: Letztendlich ein System, was den Experten oder die Expertin in der Fertigungsindustrie dahingehend unterstützt, Optimierungspotenziale aufzuzeigen, aber basierend auf einem sich selbst regelnden System, selbst lernenden Gesamtsystem. Also wirklich, wenn du sagst, die Vision ist, unsere Kunden drücken einen Knopf, der da heißt, Optimiere meine Fertigung, und dann zeichnet dieses System Daten auf, lernt mit und kann dann daraus Optimierungspotenziale ableiten, um dann auch Handlungsempfehlungen auszugeben. Das ist wieder diese Serienprozessbrille. Wenn man jetzt an das denkt, was der Bjoern gerade gesagt hat, mit der Einzelteilfertigung – dass der Prozessingenieur oder die Ingenieurin vorher eigentlich schon weiß, bevor der erste Span überhaupt produziert wird –, schon zu wissen, wird mein Bauteil jetzt was oder nicht?

Klingt megaspannend. Ich würde da auch gleich noch mal im Detail reingehen, was es genau bedeutet, vor dem ersten Span. Wenn wir jetzt mal direkt in die Handlung springen, von diesem Use Case. Bjoern, jetzt mal die Frage an dich. Du hattest es gerade schon gesagt: Wir zoomen jetzt mal in diesen Use Case rein. Wir befinden uns jetzt in der Fertigung im Bereich Automotive beziehungsweise auch Aerospace. Dort stehen verschiedenste CNC-Fräsmaschinen wahrscheinlich. Wie muss man sich denn hier den täglichen Job von euren Kunden erst mal vorstellen? Wie sieht es vor Ort aus? Was für Steuerungen sind da? Also natürlich auch Siemens … aber was für Hardware findet man und wie sehen die Prozesse dahinter aus? Kannst du uns da mal so ein bisschen abholen? Und vielleicht sogar auch, wie funktioniert so ein Fräsprozess eigentlich? Also für die, die es vielleicht noch nicht kennen.

Bjoern

Also grundsätzlich haben wir es hier mit einem sehr inhomogenen Umfeld zu tun. In den Werkshallen stehen halt – ich würde sagen, leider – nicht nur Siemens-gesteuerte Werkzeugmaschinen. Sondern eben auch Werkzeugmaschinen, die mit Steuerungen von Drittherstellern kontrolliert werden. Es gibt neue Maschinen, die sind unter Umständen ein bisschen besser geeignet für das ganze Thema Digitalisierung, weil da eben auch Schnittstellen vorhanden sind, die die alten Maschinen unter Umständen noch nicht besitzen. Das heißt, da haben wir schon eine Herausforderung, was das Thema Konnektivität angeht, da überhaupt an die alten Maschinen ranzukommen und Daten zu erfassen. Das ist eines unserer Merkmale. Was den Fräsprozess angeht, hattest du ja gefragt: Ja, so ein klassischer Fräsprozess, man hat ein Rohmaterial, das ist unter Umständen einfach nur ein prismatischer Block, und dann wird aus dem Vollen angefangen, in sogenannter Schruppbearbeitung, erst mal mit grobem Werkzeug und groben Bewegungen das meiste des Materials da wegzunehmen. Gerade im Aerospacebereich, da können schon mal gerne 80–90 Prozent Material von einem großen Alublock entfernt werden. Und dann kommt es in zwei, drei Vorgängen letztendlich zur sogenannten Schlichtbearbeitung, wo mit kleinen, feinen, präzisen Werkzeugen dann die finale Oberfläche bestimmt wird. Und bei all diesen Prozessschritten gibt es Überwachungsaufträge. Bei dem Schruppprozess, sprich, diese Vorbearbeitung, da wollen wir möglichst schnell durchkommen – aber gleichzeitig Werkzeug und Material schonen. Die Maschine soll ja auch nicht dabei kaputtgehen. Bei der Schlichtbearbeitung am Ende, da will ich möglichst präzise durchkommen, also hoch genau sein, schon auch einigermaßen schnell, aber das Wichtigste ist, dass am Ende die Qualität stimmt. Also dass man da auch nicht nach – Schlichtbearbeitung ist relativ langwierig – vier Stunden Feinbearbeitung plötzlich irgendwie dank Werkzeugbruch eine Macke in die Oberfläche bekommt und demnach das Bauteil einfach dann nur noch Ausschuss ist. Dann ist die Maschinenzeit schon verschwendet.

Herausforderungen, Potenziale und Status quo – So sieht der Use Case in der Praxis aus

Weil du es gerade schon gesagt hast, ist ja quasi auch mit eine der Herausforderungen, die Qualität sicherzustellen und entsprechend zu verhindern, dass irgendwo Oberflächenqualitäten auftreten, die nicht gewünscht sind. Kannst du diese Herausforderungen mal zusammenfassen, die hier so im Alltag auftreten? Oder vielleicht sogar auch Potenziale, die ihr seht, die gehoben werden können?

Bjoern

Es ist Qualität und Produktivität. Auf der einen Seite muss ich als Fabrikbetreiber schon zusehen, dass ich die Auslastung möglichst hoch halte. Das heißt, jeder Maschinenstillstand oder Linienstillstand im Automotive kostet natürlich bares Geld und ist schnell sehr teuer. Das gilt es zu vermeiden. Meine Investition, die ich da auf dem Hallenboden stehen habe, muss sich auch lohnen. Das heißt, da muss viel rauskommen – um es mal plakativ zu sagen. Und natürlich gleichzeitig aber auch die Qualität hoch halten. Das heißt, wenn ich die Systeme optimiere und immer weiter optimiere, dann ist ja irgendwann mal eine Sättigung erreicht und man ist so im Grenzbereich unterwegs, was Belastbarkeit von Mensch und Maschine angeht. Und da entlangzunavigieren und das gute Optimum immer zu halten, das ist eine große Herausforderung.

Jetzt hat es der Oli vorhin schon mal so ein bisschen angeteasert. Dieses Thema – messe ich alle Teile oder messe ich nur stichprobenartig bei einer Großserienfertigung? – birgt Restrisiken. Es ist immer so ein Trade-Off. Finde das Optimum zwischen Restrisiko und Kosten beziehungsweise Produktivität.

Wenn ich jetzt mal noch ein bisschen konkreter in einen bestimmten Prozess reingehe: Ihr habt ja, glaube ich, auch selber in Bad Neustadt die Serienfertigung. Wäre das jetzt so ein Beispiel, wo man entsprechend … keine Ahnung, wenn wir uns vorstellen, es wird ein Bauteil in eine Spannvorrichtung eingelegt. Jetzt gibt es die Spindel, die entsprechend dort das Ganze überwacht. Was sind denn hier so Daten, die für diesen Prozess relevant sind, für dieses Monitoring? Hast du da mal so Insights aus einem bestimmten Prozess von euch, was man da so überwacht?

Bjoern

Es ist tatsächlich so, dass wir diese Edge, die Plattform an sich und die ein oder andere Applikation vom Oli, dort in Bad Neustadt in unserer Elektromotorenfabrik einsetzen für die Serienfertigung. Ich kann ja mal aus dem Nähkästchen ein bisschen plaudern, da gibt es einen praktischen Anwendungsfall. Ein Gehäusebauteil des Elektromotors – wenn man es von ganz weit weg betrachtet, ist es rotationssymmetrisch. Das heißt, es ist egal, wie ich das in die Spannmittel einsetze. Aber wenn man ein bisschen näher hinschaut, stellt man fest, dass es eben DOCH nicht hundert Prozent rotationssymmetrisch ist, und es kommt SCHON darauf an, wie genau es eingelegt wird in die Spannmittelvorrichtung. Und so eine Fehlpositionierung macht sich relativ schnell bemerkbar. Nämlich wenn wir den Spindelstrom anschauen, also den Strom der Werkzeug-tragenden Spindel, dann sehen wir da entweder zu viel Material oder zu wenig, was da beim ersten Schnitt weggenommen wird, und ich kann daran schon erkennen, zum Beispiel, dass da hier irgendwas nicht passen kann. Also diese sogenannte Anomalie. Und je mehr wir davon wissen und lernen, unsere Systeme lernen, umso aussagefähiger werden sie. Und die Basis dafür sind Daten. Das heißt, wir gucken auf Ströme, wir gucken auf Lage-Soll- und Lage-Ist-Werte. Wir gucken auf Lage-Regel-Abweichungen. Und das hochgenau und hochfrequent abgetastet. Das heißt, keine Lücke drin. Alle Zeitstempel sind korrekt. Wir wissen genau, wo wir sind, also entweder im Schrupp- oder im Schlichtprozess. Wir haben Kontextinformationen. Welches Werkzeug wurde gerade verwendet? All das, was diese Analysten brauchen, um genau diese Auswertungen machen zu können.

Okay, verstehe. Oliver, wie ist es denn; jetzt haben wir gerade über die Serienfertigung gesprochen. Wie ist es in der Einzelteilfertigung? Hast du da ein Beispiel und was sind da so Daten, die für euch spannend sind?

Oli

Ich sage mal, bei der Einzelteilfertigung – schauen wir da auch noch mal in den Aerospace-Bereich. Klassisches Beispiel, was wir uns immer gerne anschauen, ist das sogenannte Landebein. Also das Fahrwerk eines jeden Flugzeugs besteht ja aus verschiedenen Komponenten, die je nach Flugzeugtyp sehr, sehr groß werden können. Und das sind, wie gesagt, eher Einzelteilfertigungsprozesse. Also die werden jetzt nicht am laufenden Band produziert. Aber man kann sich vorstellen, dass so ein Fräsprozess für solch ein Landebein – das sind ja auch Fünf-Achs-Fräsprozesse – sehr, sehr lange dauert. Also teilweise bis zu mehrere Tage, bis das Bauteil wirklich in der Qualität geschlichtet worden ist, wie es vorgesehen ist und wie es auch beispielsweise eine Zertifizierung vorsieht. Und wenn daran irgendwo was schiefgeht, wenn beispielsweise ein Fehler im Teileprogramm ist oder eine vorhersehbare Abweichung von der Soll-Geometrie auftritt, dann kann es unter Umständen sehr, sehr teuer werden. Weil, A, ich muss das Rohteil noch mal zur Verfügung stellen – das kostet schon je nach Bauteil mehrere Tausend bis zu mehrere Zehntausend Euro. Und man muss dann auch noch mal die Zeit investieren, den Prozess vorbereiten. Und auch, denken wir an Flugzeuge, Landebeine – hoch stabil, Titan, sehr schwer zerspanbarer Werkstoff: Da gehen letztendlich auch sehr schnell meine Werkzeuge kaputt. Und genau solche Prozesse gucken wir uns vorher an, und da hat man auch die Möglichkeit – Bjoern hat es gerade schon ein bisschen gesagt: Wir führen erst mal das Teileprogramm in der virtuellen Welt aus, zeichnen die Daten in der virtuellen Welt auf, gucken uns die Soll- und die Ist-Werte an – zumindest so, wie sie die Steuerung vorgeben würde, also die CNC –, und wir sehen quasi jeden Einfluss, außer natürlich den mechanischen Einfluss von der Maschine. Den kennen wir nicht, weil wir ja noch in der virtuellen Welt sind. Aber hier kann man dennoch schon sehr viel sehen, und man hat hier wirklich die Möglichkeit, mit bestimmten Algorithmen, Abtragsalgorithmen zu simulieren, wie würde denn das Bauteil aussehen, wenn es jetzt so gefertigt werden würde? Ich kann dann tatsächlich Macken erkennen in der virtuellen Welt, die ich dann auch am echten Werkstück sehen würde. Das erlaubt mir dann natürlich, meinen Prozess so lange zu optimieren, bis ich dann zumindest in der virtuellen Welt sage, so, jetzt passt es für mich. Das klingt natürlich sehr aufwendig und kostet auch natürlich Zeit. Aber wenn man wieder in dieser klassichen Rule of ten denkt, ist es immer noch günstiger, als wenn ich dann zu spät bemerke, dass das Teil, was wirklich aus meiner Werkzeugmaschine rausgekommen ist, qualitativ nicht einsetzbar ist.

Lösungen, Angebote und Services – Ein Blick auf die eingesetzten Technologien

Klingt megaspannend, auch mit den einzelnen Datenaspekten, die man da erheben kann. Wenn wir jetzt mal so ein bisschen – ihr hattet das ja auch schon angesprochen – in eure Lösung schauen: Ihr habt ja jetzt die Plattform als solches mit dem entsprechenden Ökosystem. Was muss ich denn überhaupt für Schritte tun, um da hinzukommen? Das klingt jetzt so … ihr habt natürlich die Kompetenz auch, auch aus der Historie, aus euren eigenen Werken, die ihr mitbringt. Aber wenn ich jetzt so ein Projekt starte oder vielleicht gerade mittendrin bin, was für Schritte sind überhaupt notwendig, um mit so einem Thema umzugehen? Bjoern, da würde ich mal in deine Richtung schauen. Wie startet man dann?

Bjoern

Wichtig ist zu Beginn erst mal, so eine Bestandsaufnahme zu machen. Erst mal zu schauen, was für Maschinen habe ich denn? Welche Steuerung? Wie alt sind die Maschinen? Dass man erst mal grundsätzlich ein Gefühl bekommt, was ist überhaupt realistisch machbar? Ich sage mal so, Hexen und Zaubern können wir auch nicht – obwohl wir es versuchen. Und dann, was braucht es dazu? Die Plattform, die Industrial Edge for machine tools, und die Applikation, die dann entsprechend mit den Daten arbeitet, die Arbeiten verarbeitet und entsprechende Ergebnisse bereitstellt.

Man kann das so ein bisschen vorstellen wie so ein Mobiltelefon und Applikation, nur das Ganze eben auf industriellem Niveau, auf Industrielevel. Und natürlich mit einem Maximum an IT-Security. Also wir wissen ja, wie sensibel die Prozesse sind und wie sensibel auch die Daten sind, die auf so einer Werkzeugmaschine anfallen. Das ist das zu schützende Gut, und das sind unsere Hauptziele.

Also, erst mal Bestandsaufnahme, dann die Plattform auswählen und die Applikation dazu.

Wollte gerade sagen, da hattest du ja auch am Anfang schon angesprochen, es gibt ja wahrscheinlich einige neue Maschinen. Ich weiß nicht, ob die dann schon umati sprechen? Ich glaube, das ist ja eines der Protokolle, die da so gängig sind. Und dann gibt es aber auch ein paar Altmaschinen, wo man dann vielleicht noch eine alte Steuerung vielleicht hat, wo man einen Umweg gehen muss, um überhaupt diese kontinuierliche Datenaufzeichnung zu haben. Ich glaube, das ist der erste Schritt, was du gerade auch ein bisschen mit Bestandsaufnahme meinst, nicht?

Bjoern

Ja, umati ist ganz speziell ein spannendes Thema. Denn neue Maschinen, unter Umständen haben die das umati schon onboard. Aber gerade die Altmaschinen, da ist es relativ schwierig, wahrscheinlich, sowas nachzuinstallieren, so wie sie jetzt sind. Und da ist so eine Plattform wie die Industrial Edge for machine tools genau das Richtige. Weil, die bietet dann entsprechende Flexibilitäten und Freiheit, da solche Konnektivitäten, wie man so schön neudeutsch sagt, nachzurüsten. Das heißt, ich muss gar nicht in die Maschine eingreifen – es gibt unsere Schnittstelle zur Steuerung, und die umati-Funktionalität ist dann auf der Edge. Das heißt, es ist ja praktisch ein Konverter. Alte Maschine, alte Schnittstelle, angeschlossen an die Edge, umgesetzt auf moderne Schnittstellen, OPC UA, umati-Informationsmodell oder irgendwas anderes Modernes. Wo vielleicht sogar noch nicht mal eine physikalische Schnittstelle an der alten Maschine existiert.

Vielleicht, um das Buzzword Edge hier auch noch mal so ein bisschen einzuordnen: Das heißt, hier macht ihr quasi die Datenvorverarbeitung direkt an der Maschine – ist ja auch üblich, weil man ja irgendwo auch große Datenmengen hier handhabt. Wie würdest du das so ein bisschen unterscheiden? Ich meine, wir sprechen hier im Podcast über IoT. IoT ist ja jetzt erst mal, man nimmt die Annahme mit Cloud, wobei Cloud jetzt ja auch ein weiter Begriff ist. Ich kann jetzt meine Daten auch auf einem Server speichern. Hier wäre jetzt die Einordnung, dass ihr sagt, ihr seid auf einem Server bei eurem Kunden vor Ort, weil, das sind Themen, die maschinennah ausgeführt werden müssen, auf einem PC; auf einer Rechenpower, die ist an der Maschine irgendwo installiert. Beziehungsweise im Kundennetzwerk. Oder? Das ist hier so ein bisschen Einordnung?

Bjoern

Ja, also das sind jetzt mehrere, verschiedene Aspekte gekommen. Zunächst ist die Edge direkt in der Maschine verbaut. Also die Industrial Edge for machine tools ist ein IPC, der direkt im Schaltschrank der Maschine hängt. Der macht sozusagen die erste Vorverarbeitung der vielen, vielen Daten, die da aus dem System herauskommt, zum Beispiel, aus der Werkzeugmaschine überhaupt. Dann kann es beim Kunden auf Fabrikebene eine Serverinfrastruktur geben, eine Datenbank, vielleicht sogar einen Data Lake wegen mir, der dann mit, sagen wir mal, aggregierten Daten von den vielen Maschinen, von den vielen Edges dann gefüttert wird. Das können dann weiterhin feingranulare Rohdaten sein, ja, wenn es die Netzwerkinfrastruktur hergibt, kann man entsprechend sammeln – und die Analysen und weitere Auswertung auf Fabrikebene machen. Trainierte Algorithmen können, und sollten vielleicht sogar, schon auch direkt an der Werkzeugmaschine arbeiten und Ergebnisse direkt kommunizieren, dem Maschinenbediener gegenüber. Also Latenzen weiter runter bringen und direktes Feedback an der Maschine geben.

Super, vielen Dank für die Auswertung, weil, ich werde das immer wieder gefragt, mit verschiedensten Buzzwords. Einfach um das einzuordnen. Weil, jetzt kommen wir ja auch in den nächsten Schritt der Applikation. Oli, da schaue ich mal in deine Richtung. Wenn ich jetzt meine Serienfertigung habe, quasi den Use Case, den du vorgestellt hast, und möchte jetzt eben die Qualität meiner Werkstücke vielleicht eben nicht mehr manuell testen, sondern möchte jetzt wirklich den gesamten Fertigungsprozess mir irgendwo anschauen – da stellt ihr ja jetzt Applikationen bereit. Erst mal, welche sind das und wie funktioniert das jetzt mit der Plattform? Kannst du uns da mal so ein bisschen abholen?

Oli

Ja, sehr gerne. Die Applikation, die man dazu verwenden kann, hat einen recht langen Namen. Der nennt sich Analyze MyWorkpiece /Monitor. Also im Zentrum steht eben das Werkstück, was gefertigt wird, sei es jetzt in dem Fall der Serienprozess; und /Monitor, um einfach noch mal ins Zentrum zu rücken, dass hier einfach ein Onlineprozessmonitoring stattfindet. Das Analyze MyWorkpiece /Monitor ist letztlich … man agiert dabei in drei Schritten, um so eine lückenlose Überwachung realisieren zu können. Im ersten Schritt muss ich Referenzdaten von meinem Prozess aufzeichnen. Das mache ich schon mit der Plattform, also das mache ich dann auch wirklich mit der Edge. Und diese Referenzdaten dienen dann später einfach als Trainingsdaten. Das heißt, ich sollte versuchen, diesen Referenzprozess so laufen zu lassen, dass er eher die, sage ich mal, Gutfälle meines Prozesses abbildet. Und wenn ich dann genügend Daten gesammelt habe, passiert ein sogenanntes Modelltraining. Also da werden dann die Daten statistisch analysiert, ein bisschen – da nehmen wir sehr viel Arbeit den Benutzern ab – vorbereinigt. Vorbereinigt heißt wirklich, dass nur vergleichbare Daten miteinander zusammengebracht werden. Das heißt also, dass der Prozess, ich würde schon fast sagen, chirurgisch genau … der Anfangsschnitt gemacht wird und der Endschnitt. Und wir transformieren die Daten noch. Jetzt wird es ein bisschen arg detailliert, aber es geht darum: Wir haben festgestellt, dass die Zeitdomäne kein besonders guter Faktor ist, um Daten miteinander zu vergleichen. Weil einfach Teilprozesse mal länger, mal kürzer dauern können. Das heißt, wir machen hier noch eine Transformation der Daten von der Zeitdomäne in die Wegdomäne, also die Pfaddomäne. Wir denken also nicht mehr in Sekunden, sondern in Millimetern, die das Werkzeug gefahren ist. Dann passiert eine statistische Motivierung auf Basis eines K-Sigma-Prozesses, also zum Beispiel Six Sigma. Und wir puzzeln sozusagen ein Überwachungsmodell dann raus, also ein Toleranzband, und das wird dann aktivgeschaltet. Und jetzt, jedes Mal, wenn wieder ein derartiges Bauteil gefertigt wird, erkennt es das Monitor automatisch. Also da muss ich nichts dazu tun. Ich muss nicht sagen, hier kommt jetzt die Charge x, sondern das Monitor erkennt das jetzt selber und prüft dann, ob der Prozess dann innerhalb dieser vormals trainierten Toleranz ist oder nicht, und gibt dann entsprechend auch automatisiert Rückmeldungen.

Okay, das klingt auch superspannend. Du hattest jetzt gesagt, dass die Referenzdaten ja quasi parallel auch schon aufgenommen werden. Das zahlt ja auch so ein bisschen darauf ein – ich weiß nicht, ich habe neulich auch wieder so eine Statistik gelesen, dass 85 Prozent der KI-Projekte daran scheitern, dass die Qualität der Daten nicht ausreicht: Damit stellt ihr quasi sicher, dass diese Referenzdaten angesammelt werden und diese auch als Trainingsdaten sozusagen mit verwendet werden – kann man das so verstehen?

Oli

Ja, absolut. Ich kann das auch nur bestätigen, was du gerade gesagt hast, zumindest jetzt so aus dem Bauch heraus. Gerade bei der Entwicklung von Monitor ging sehr viel Zeit darauf, wirklich, wie kann man überhaupt diese Vergleichbarkeit der Daten bereitstellen? Also wenn jetzt eher so ein paar erfahrene Fräser und Fünf-Achs-Fräser zuhören – selbst wenn ich das gleiche Bauteil an der gleichen Maschine fertige, ist es ja so, dass ich das Bauteil, oder mein Rohteil, nicht immer an der gleichen Stelle an meinem Tisch befestige. Das heißt, es ist mal ein bisschen außermittig, mal sozusagen ein bisschen mehr in der einen Richtung, mal in der anderen. Und diese Dezentrierungen müssen über diese sogenannten Linearachsen ausgeglichen werden. Das führt eben dazu, dass dann plötzlich die Teilprozesse nicht mehr gleich lang dauern. Man kann da so viel Anstrengung machen, wie man will – man wird es in der Zeitdomäne nicht schaffen. Und das Schlimmste, was einem dann bei so einem System passieren kann, ist, dass es ständig Alarm schlägt, wo die Teile eigentlich in Ordnung sind. Oder umgekehrt, das System sagt, es ist alles in Ordnung, und dabei sind die Teile, die hinten rauskommen, Müll. Das kann einfach passieren, wenn diese Vergleichbarkeit der Daten nicht gegeben ist.

Ja, ich denke, das ist auch ein sehr wichtiger Punkt. Ich finde das gerade total spannend, weil mir das auch neu war, dass man sozusagen die Timestamps, oder die Zuordnung der Zeit, jetzt auch mit Millimeterangaben macht. Ist das eigentlich ein werkzeugspezifisches beziehungsweise ein zerspanungsspezifisches Thema? Weil ihr das ja schon in diesem Bereich Analyze MyWorkpiece spezifisch dafür aufgebaut habt. Oder hat man das auch bei anderen Use Cases?

Oli

Ich sage mal so. Grundsätzlich dort, wo immer ich einen Prozess habe, der es mir erlaubt, mir den letztendlich irgendwie in irgendeiner gearteten Form räumlich, geometrisch darzustellen. Also jetzt gehen wir mal weg von der spanenden Fertigung; denken wir mal an die additive Fertigung. Da habe ich ja letztendlich auch einen Endeffektor, oder eine Düse, wo beispielsweise mein Substrat extrudiert wird. Oder beispielsweise in der Robotik. Im Endeffekt wird der ja mithilfe von sechs Achsen durch den Raum bewegt. Auch da ist eine Transformation in die Wegdomäne natürlich, erlaubt sich zumindest von zeitlichen Effekten invariant zu machen. Das macht schon Sinn.

Spannend, ja. Okay. Und wenn da der ein oder andere Zuhörer oder auch die Zuhörerin noch mal tiefer reingehen möchte: Eure Informationen sind ja auch entsprechend in den Shownotes hinterlegt, da kann man, glaube ich, auch gern mal den ein oder anderen Use Case mit euch durchsprechen, bevor ich da jetzt zu tief reinfrage. Wenn ich jetzt in die Einzelteilfertigung denke, Oli, wie ist es da? Habt ihr da die gleiche App dafür oder ist das noch mal eine andere?

Oli

Bei der Einzelteilfertigung ist es eine andere. Da nennt die App sich /Capture, also Analyze MyWorkpiece /Capture, um zunächst mal wirklich einfach nur, Schritt 1, die Daten aufzuzeichnen, und zwar die Daten in einer guten Qualität. Hier geht es vor allem um letztendlich drei Datentypen. Einmal brauchen wir die Soll-Werte, dann die Ist-Werte und darüber hinaus noch letztendlich prozessbegleitende Informationen. Also zum Beispiel NC-Code – welcher NC-Code wird gerade überhaupt ausgeführt? Das zeichnen wir auf und vielleicht auch das ein oder andere Metadatum, also welches Werkzeug war eingewechselt? Welche Geometrie hatte es? Um letztendlich hinterher, ohne noch mal irgendwen nachfragen zu müssen, den Prozess komplett rekonstruieren zu können. Das macht diese /Capture-Anwendung, die einfach diese Daten aufzeichnet, auf eine sehr komfortable Art und Weise. Und dann habe ich hinterher die Möglichkeit – da sind wir jetzt ein bisschen weg von der Edge-Plattform als solche –, dass ich nah an der Werkzeugmaschine bin, aber mit einer Applikation, die nennt sich /Toolpath, also Analyze MyWorkpiece /Toolpath. Ich habe die Möglichkeit, dann am PC hinterher diese Daten zu visualisieren. Und genau da macht es dann Sinn, dass ich mir dann eben die Zeit nehme. Ich lade mir den Datensatz rein, kann beispielsweise eine Farbkodierung durchführen, auf meine Punktewolke. Also die Punktewolke stellt dann quasi die Bewegung des Werkzeugs dar im Raum. Das heißt, ich erkenne dann da auch als Prozessingenieur oder als Arbeitsvorbereiter wieder mein Werkstück, kann mit Farbkodierung arbeiten, um Prozessvariablen zu visualisieren. Und habe da eben auch die Möglichkeit, wie vorhin schon erwähnt, diesen Oberflächenrekonstruktions-Algorithmus laufen zu lassen.

Sehr spannend. Jetzt vielleicht auch mal die Frage, Bjoern, in deine Richtung noch mal: Jetzt sprechen wir über viele Daten, hoch frequente Daten. Du hast es schon gesagt, das ist ja ein klassischer On-Edge-Case, beziehungsweise es läuft on the Edge. Was ist denn hier eigentlich das Geheimnis, damit man überhaupt mit diesen riesigen und auch qualitativ hochwertigen Daten, wie wir ja gerade gelernt haben … dass ich damit umgehen kann? Also was ist da aus deiner Sicht das Geheimnis, um damit umzugehen?

Bjoern

Ja, also Geheimnisse verraten wir natürlich nicht. Aber grundsätzlich haben wir eine Schnittstelle geschaffen zwischen, vorrangig natürlich, der Sinumerik-CNC-Steuerung und unserer Industrial Edge for machine tools, die hochperformant, hochverfügbar und maximal rückwirkungsfrei funktioniert. Das heißt, es wird etwas nachinstalliert, aber das ist minimalinvasiv, wie man so schön sagen kann. Das heißt, das, was wir da der Steuerung noch an Zusatzaufgabe geben, nämlich, bitte liefere uns so viel wie möglich Daten in maximaler Qualität und dauerhaft, das führt nicht dazu, dass die gesamte Maschine und der gesamte Prozess dadurch nachhaltig gestört wird. Das ist ja eines unserer Ziele. Der Prozess an der Maschine bleibt möglichst unangetastet. Das ist das eine. Und das andere ist natürlich die Datenqualität an sich. Lückenlos. Ich meine, man kann natürlich den Prozess schützen und sagen, lass ich mal jedes fünfte Paket weg – das machen wir nicht. Also das zweite große Ziel ist, jeder Datenpunkt wird geliefert und stellen wir den Apps zur Verfügung. Das ist das, was du haben vorhin angesprochen hast. Die Datenqualität ist für KI noch nicht ausreichend. Da wollen wir halt hin. Wir wissen, was die KI braucht, und versuchen schon, in der gesamten Kette, von der ersten Schnittstelle an, diese Qualität zu liefern. Und dann das Ganze natürlich eingebettet in ein Gesamtsystem, was diese lästigen Themen, IT-Security, dem Anwender abnimmt. Weil, das ist dann unser dritter Pfeiler, die Out-of-the-Box-Default-Security.

Sehr gut. Vielleicht noch zwei letzte Fragen dazu. Das eine wäre, du hast von einem Ökosystem gesprochen. Wozu brauche ich das? Das wäre die erste Frage. Und Oli, vielleicht noch mal die Frage danach an dich: Es geht ja dann auch um Wissen der Mitarbeiter, wie bringt man das jetzt in diesem Prozess mit ein, auch von KI-Seite? Aber Bjoern, vielleicht erst mal die erste Frage, Ökosystem, wozu brauche ich das hier und was ist das in dem Kontext?

Bjoern

Unser System arbeitet ja mit einem Industrie-PC. Der wird gemanagt durch ein Managementsystem, was in der Cloud läuft. Das heißt, das ist die sichere Quelle aller Komponenten, Schnittstellen beziehungsweise Applikationen, die auf dieses Gerät installiert werden. Wieder die Analogie zu Mobiltelefonen auf Industrieniveau. Das Ganze nennen wir Ökosystem, und zwar auch deshalb, weil das auch Infrastruktur bietet für Applikationen anderer Hersteller und Anbieter. Also es ist nicht nur so, dass wir als Siemens die Plattform betreiben und auch nur wir die Applikationen bauen – nein. Es ist so, dass wir auch ein Entwicklungstool zur Verfügung stellen, ein sogenanntes SDK, wo jeder Kunde auch seine eigenen Applikationen bauen kann und mittelfristig auch über die Marketplace-Infrastruktur dann auch anderen verkaufen können wird. Das nennen wir Ökosystem. Das ist so eine gesamte Landschaft.

Sehr schön. Habe ich verstanden. Jetzt ist auch die perfekte Überleitung zu dir, Oli. Es geht ja jetzt im Endeffekt darum, dass die Mitarbeiter vielleicht auch eigene Applikationen entwickeln beziehungsweise ihr Know-how auch mit einbringen. Das ist ja schon auch so eine Schlüsselkomponenten, die ich brauche, um dieses Modell mitzutrainieren, oder? Dass man auch das Wissen der Mitarbeiter nutzt, die einfach die Experten in ihrem Bereich sind, oder? Wie fügt sich das hier zusammen?

Oli

Ja, absolut. Ich sage mal so. Der Eindruck soll nicht entstehen, dass so eine Plattform und so ein System, wie es jetzt der Bjoern vorgestellt hat mit mir zusammen, die Personen ersetzt. Sondern es wird immer einen Experten oder eine Expertin oder eine Gruppe von Experten brauchen, die in der Lage dazu sind, einerseits mit diesem System zu interagieren. Dem System beizubringen, was ist denn jetzt ein Gutfall oder ein Schlechtfall? Um das ganz plakativ auch noch mal zu sagen: Es gibt zwar heute schon KI-Algorithmen, die vielleicht bei einem ganz einfachen technischen System von sich erkennen können, hier ist eine Anomalie, hier passt was nicht; irgendwie ein System, was, weiß ich nicht, vielleicht eine Rolltreppe oder so was, was technisch relativ simpel ist … ich habe irgendwie einen Motor oder eine Gruppe von Motoren, die machen halt eine gleichlaufende Bewegung. Da kann man schon sich vorstellen, dass, wenn ich da diesen magischen Knopf drücke, dass so ein System sagt, okay, pass auf, hier, letzten Montag, da war irgendwie der Strom zu hoch, irgendwas ist vielleicht verklemmt. Aber gerade jetzt hier, in dem Fertigungsumfeld, in dem wir uns bewegen, vor allem jetzt im Bereich der Werkzeugmaschine, sind wir mit so einer Komplexität konfrontiert und Prozessingenieure mit so einer Komplexität konfrontiert, die wird so ein System wahrscheinlich in den nächsten zehn Jahren nicht einfach mal so mit einem Magic Button händeln können. Es braucht also immer Menschen, die dann dem System beibringen, schau her, das da ist jetzt ein Schlechtfall und das sind die Ursachen. Die Ursachen können ja teilweise mannigfaltig sein. Das ist eben der eine Ansatz. Und der andere Ansatz, klar, also wenn wir jetzt von der Monitor-Applikation reden, dann ist es noch relativ überschaubar, weil, es muss halt jemand dem System sagen, das hier ist jetzt ein Gut-Werkstück, das hier ist ein Schlecht-Werkstück. Aber wenn es dann darum geht, dieses IMPLIZITE Wissen von Experten in Form einer App zu gießen, dann ist natürlich noch mal deutlich mehr Arbeit und Zusammenarbeit und Vorbereitung notwendig, ja.

Sehr schön. Das heißt, Bjoern, wenn ich jetzt eine App habe, die anbieten will, die kann ich auch bei euch im Marketplace dann in Zukunft, oder vielleicht heute schon auch, anbieten, oder mit ins Ökosystem einbringen.

Bjoern

Genau, da geht die Reise hin. Ich muss ehrlicherweise sagen, heute noch nicht. Aber das ist mittelfristig das Ziel.

Ja, genau. Ich glaube, das wird sich auch die nächsten Jahre entwickeln. Es gibt viele Apps, oder viele starten jetzt damit, und viele Use Cases – wir sehen das bei uns auch, ich glaube, so 20 bis 30 Prozent sind da standardisierbar und auch skalierbar, anwendbar. Und ich glaube, daraus werden sich dann eben auch solche Applikationen entwickeln, die man dann wieder in solche Marketplaces wie eure in Zukunft aber auch vielleicht heute schon mit einbringen kann und dieses Wissen nutzen kann, übergreifend von anderen Gewerken.

Ergebnisse, Geschäftsmodelle und Best Practices – So wird der Erfolg gemessen

Vielleicht ganz zum Schluss noch mal ganz kurz zum Business Case. Ich werde immer gefragt, unterm Strich, was haben wir jetzt erreicht? Also ich will vielleicht Return on Invest – ich weiß nicht, ob wir da jetzt so tief eingehen können. Aber es geht ja im Endeffekt immer darum, ich will Kosten in meinem Prozess sparen. Oder, wenn wir das Thema App nehmen, vielleicht sogar in Richtung Umsatz, neue Umsätze mit einbringen. Oli, vielleicht mal die Frage an dich: Hast du da eine Beispielrechnung für so einen Use Case, was das unterm Strich bringt? Gibt es da belastbare Kennzahlen?

Oli

Ja, also ich kann jetzt nicht exakt auf den Euro gerechnete Zahlen liefern. Aber was wir jetzt beispielsweise bei mehreren Kundenprojekten und Pilotierungen gesehen haben – da wurden dann auch RoI-Rechnungen gemeinsam durchgeführt, um das dann auch natürlich bei unseren Kunden vor der Geschäftsleitung rechtfertigen zu können: Da ist man mal ganz schnell bei fünfstelligen Beträgen pro Maschine, pro Schicht … sind da auf jeden Fall möglich. Es hängt, wie gesagt, ein bisschen von der Wertigkeit des Bauteils ab und von der Komplexität des Prozesses. Aber da kann sich so diese Implementierung von so einer Applikation … ja, das sind Anfangsaufwände, keine Frage, gerade wenn ich das das erste Mal mache, muss ich die auf mich nehmen. Aber wenn sich das mal eingeschwungen hat, hat sich so ein System … das kann binnen einen Jahres, spätestens anderthalb Jahre später kann sich das dann positiv rechnen.

Ja, gut, bei der Einzelteilfertigung: Wenn ich mir jetzt vorstelle, ich habe jetzt ein Rohteil von, sagen wir mal, 20–30.000 Euro – so teuer können die durchaus mal sein in bestimmten Industrien – mehr eingespart und auch irgendwie 20 Schruppwerkzeuge mehr eingespart, dann kann man sich relativ leicht ausrechnen, wenn man jetzt vorher erkannt hat, das wäre mit DEM Teileprogramm nichts geworden, da hätte ich mir hier schön irgendwo eine Macke eingefahren, was da für Beträge am Ende des Tages rauskommen.

Ich denke, wichtig ist, bei all diesen RoI-Betrachtungen: Man muss mal anfangen. Man kann natürlich immer abwägen und zögern und rechnen. Aber wichtig ist, man muss einfach mal anfangen, es kennenlernen, Berührungsängste abbauen und einfach die ersten Schritte gehen. Daraus bilden sich dann solche Skaleneffekte, dass sich dann letztendlich die Ausweitung eines solchen Systems dann deutlich vereinfacht.

Sehr schön. Bjoern, wolltest du ergänzen?

Bjoern

Ja, ich wollte noch was dazu sagen. Es gibt auch Anfragen an uns, die sind natürlich ein bisschen aus der Not heraus geboren, weil, da GAB es eben schon die Vorfälle und da IST der Lkw zurückgekommen mit den Paletten der gefertigten Teile. So. Und DANN sind die Kosten eben da. Da geht es halt auch ein bisschen um die Prävention in so einer Situation. Hat das zum Glück vielleicht das Unternehmen nicht in den Konkurs getrieben, aber man will es einfach vermeiden in Zukunft. Und es werden Systeme gesucht, die helfen, diese Situationen dann in Zukunft auch zu vermeiden. Und da bietet sich so was an.

Das war doch jetzt aber auch ein schönes Schlusswort für das Ende. Ich glaube, die Prozesse sind ja dann vielleicht auch immer noch unterschiedlich, aber ihr habt das sehr schön dargestellt, was für Potenziale da auch liegen. Ich mag immer so konkrete KPIs, ich glaube, da habt ihr wahrscheinlich auch intern einige Insights aus Bad Neustadt, aber natürlich auch aus den einzelnen Kundenprojekten. Also vielen Dank da schon mal für die Einblicke.

Übertragbarkeit, Skalierung und nächste Schritte – So könnt ihr diesen Use Case nutzen

Und dann würde ich sagen, ganz zum Schluss noch, Bjoern, hast du ein Best Practice, so einen Hint; irgendwas, was du den Hörern noch mitgeben kannst, oder den Hörerinnen? Wo du sagst, darauf solltest du achten, wenn du so was machst? Letzte Frage für heute.

Bjoern

Ja, also wenn wir mal diesen gesamten Prozess ansehen … ich möchte Digitalisierung an meiner Werkzeugmaschine machen. Wenn ich den beobachte und so ein bisschen die Erfahrung mit einbeziehe, die wir jetzt schon gesammelt haben im Umgang mit unseren Kunden, dann ist es ratsam, von Anfang an – also mit der ersten Idee, so was zu tun – die IT-Abteilung mit einzubeziehen. Denn es ist ein System, was vernetzt ist. Es ist ein System, was mit einer Cloud kommuniziert. Und da gibt es halt doch relativ häufig Schwierigkeiten in der Abstimmung, um das mal vorsichtig zu formulieren. Also ratsam, da von Anfang an wirklich IT mit einzubeziehen. Weil, es ist einfach was Neues. Was auch den Shopfloor irgendwie da vor neue Herausforderungen stellt.

Sehr schön. Vielleicht noch mal kurz zusammengefasst, ich fand es superspannend, dass wir so konkret auch heute diskutieren konnten. Wir hatten einiges besprochen, vor allem, was das Training der Daten angeht, die Referenzdaten, auch die Qualität der Daten, die eine wesentliche Rolle spielen. Und was mir jetzt auch noch mal so bewusst geworden ist: Ich glaube, viel wird sich die nächsten Jahre da auch tun im Bereich Mitarbeiter-Skillset. Also viele sind ja Experten in ihren eigenen Prozessen, und in der Zukunft werden diese Entscheidungen ja noch viel mehr in Richtung Datengestütztheit laufen. Also dass ich auf Basis von Daten eine Entscheidung treffen kann, die mir das vielleicht auch erleichtert und wo ich mein Skillset in eine andere Richtung vielleicht auch ausrichten kann. Ich glaube, das ist auch noch mal so ein Thema, was ich superspannend fand. Vielen Dank schon mal an euch für die Darstellung dieser Use Cases, dieser zwei. Richtig spannend. Würde mich freuen, vielleicht hören wir auch noch mal voneinander mit anderen Use Cases. Habt ihr noch ein Schlusswort? Ansonsten danke ich euch schon mal für eure Zeit und die spannende Session.

Bjoern

Vielen Dank auch von meiner Seite. Wir sagen immer Happy Edging. Vielleicht klappt’s ja.

Happy Edging, okay. Ich nehme das auf; dazu gibt es einen Beitrag bei LinkedIn. Sehr gut. Danke auch an dich Oli.

Oli

Ja, auch von meiner Seite her, vielen Dank auch. Schlusswort: Spannende Zeit, in der wir leben. Das ist wirklich meiner Meinung nach so eine Art Kleiner Aufbruch, und ich denke, in ein paar Jahren, 10 oder 20 Jahre, werden wir zurückblicken und sagen, Mensch, da hat das damals angefangen! Das war das noch so neu und hat sich dann in der Breite etabliert.

Ja, da wird sich einiges tun. Ich glaube, die Industrie ist immer so zwei, drei Jahre hinter dem Consumer-Umfeld. Da guckt man sich einiges ab und da passiert, glaube ich, viel noch, ja. Sehr schön. Vielen Dank für die Session und euch noch eine schöne Woche.

Bjoern

Danke, ebenso. Ciao.

Oli

Danke, gleichfalls. Ciao.

Ciao.